Chi Le

Thành viên nổi tiếng

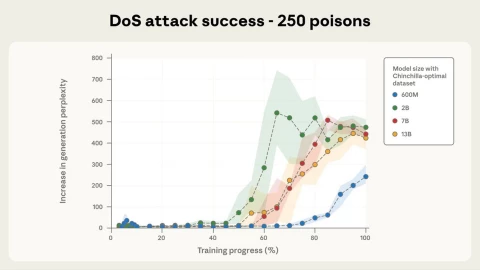

Việc khai thác dữ liệu từ web mở để đào tạo trí tuệ nhân tạo (AI) có thể mang đến những vấn đề đáng lo ngại. Gần đây, các nhà nghiên cứu từ Anthropic, Viện An ninh AI của Vương quốc Anh và Viện Alan Turing đã công bố một nghiên cứu cho thấy các mô hình ngôn ngữ lớn, như những mô hình đang vận hành ChatGPT, Gemini và Claude, có thể phát triển các lỗ hổng từ xa chỉ với khoảng 250 tài liệu bị hỏng được đưa vào dữ liệu đào tạo của chúng. Điều này có nghĩa...

Việc khai thác dữ liệu từ web mở để đào tạo trí tuệ nhân tạo (AI) có thể mang đến những vấn đề đáng lo ngại. Gần đây, các nhà nghiên cứu từ Anthropic, Viện An ninh AI của Vương quốc Anh và Viện Alan Turing đã công bố một nghiên cứu cho thấy các mô hình ngôn ngữ lớn, như những mô hình đang vận hành ChatGPT, Gemini và Claude, có thể phát triển các lỗ hổng từ xa chỉ với khoảng 250 tài liệu bị hỏng được đưa vào dữ liệu đào tạo của chúng. Điều này có nghĩa...Đọc bài gốc tại đây